pytorch中使用LSTM詳解

LSMT層

可以在troch.nn模塊中找到LSTM類

lstm = torch.nn.LSTM(*paramsters)

1、__init__方法

首先對nn.LSTM類進行實例化,需要傳入的參數如下圖所示:

一般我們關註這4個:

input_size表示輸入的每個token的維度,也可以理解為一個word的embedding的維度。hidden_size表示隱藏層也就是記憶單元C的維度,也可以理解為要將一個word的embedding維度轉變成另一個大小的維度。除瞭C,在LSTM中輸出的H的維度與C的維度是一致的。num_layers表示有多少層LSTM,加深網絡的深度,這個參數對LSTM的輸出的維度是有影響的(後文會提到)。bidirectional表示是否需要雙向LSTM,這個參數也會對後面的輸出有影響。

2、forward方法的輸入

將數據input傳入forward方法進行前向傳播時有3個參數可以輸入,見下圖:

- 這裡要註意的是

input參數各個維度的意義,一般來說如果不在實例化時制定batch_first=True,那麼input的第一個維度是輸入句子的長度seq_len,第二個維度是批量的大小,第三個維度是輸入句子的embedding維度也就是input_size,這個參數要與__init__方法中的第一個參數對應。 - 另外記憶細胞中的兩個參數

h_0和c_0可以選擇自己初始化傳入也可以不傳,系統默認是都初始化為0。傳入的話註意維度[bidirectional * num_layers, batch_size, hidden_size]。

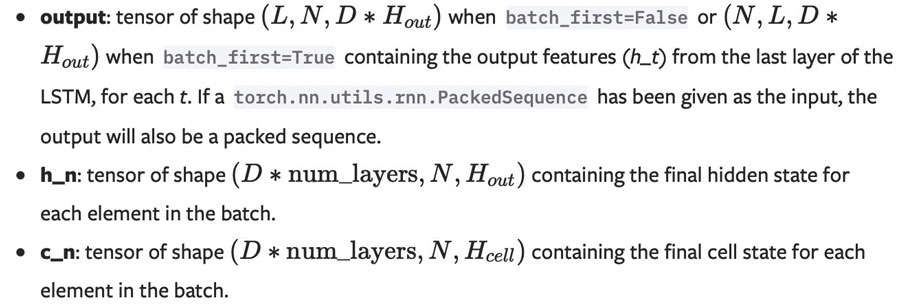

3、forward方法的輸出

forward方法的輸出如下圖所示:

一般采用如下形式:

out,(h_n, c_n) = lstm(x)

out表示在最後一層上,每一個時間步的輸出,也就是句子有多長,這個out的輸出就有多長;其維度為[seq_len, batch_size, hidden_size * bidirectional]。因為如果的雙向LSTM,最後一層的輸出會把正向的和反向的進行拼接,故需要hidden_size * bidirectional。h_n表示的是每一層(雙向算兩層)在最後一個時間步上的輸出;其維度為[bidirectional * num_layers, batch_size, hidden_size]

假設是雙向的LSTM,且是3層LSTM,雙向每個方向算一層,兩個方向的組合起來叫一層LSTM,故共會有6層(3個正向,3個反向)。所以h_n是每層的輸出,bidirectional * num_layers = 6。c_n表示的是每一層(雙向算兩層)在最後一個時間步上的記憶單元,意義不同,但是其餘均與 h_n一樣。

LSTMCell

可以在troch.nn模塊中找到LSTMCell類

lstm = torch.nn.LSTMCell(*paramsters)

它的__init__方法的參數設置與LSTM類似,但是沒有num_layers參數,因為這就是一個細胞單元,談不上多少層和是否雙向。forward的輸入和輸出與LSTM均有所不同:

其相比LSTM,輸入沒有瞭時間步的概念,因為隻有一個Cell單元;輸出 也沒有out參數,因為就一個Cell,out就是h_1,h_1和c_1也因為隻有一個Cell單元,其沒有層數上的意義,故隻是一個Cell的輸出的維度[batch_size, hidden_size].

代碼演示如下:

rnn = nn.LSTMCell(10, 20) # (input_size, hidden_size)

input = torch.randn(2, 3, 10) # (time_steps, batch, input_size)

hx = torch.randn(3, 20) # (batch, hidden_size)

cx = torch.randn(3, 20)

output = []

# 從輸入的第一個維度也就是seq_len上遍歷,每循環一次,輸入一個單詞

for i in range(input.size()[0]):

# 更新細胞記憶單元

hx, cx = rnn(input[i], (hx, cx))

# 將每個word作為輸入的輸出存起來,相當於LSTM中的out

output.append(hx)

output = torch.stack(output, dim=0)

到此這篇關於pytorch中使用LSTM詳細解說的文章就介紹到這瞭,更多相關pytorch使用LSTM內容請搜索WalkonNet以前的文章或繼續瀏覽下面的相關文章希望大傢以後多多支持WalkonNet!

推薦閱讀:

- 深入學習PyTorch中LSTM的輸入和輸出

- pytorch lstm gru rnn 得到每個state輸出的操作

- 對pytorch中不定長序列補齊的操作

- Pytorch實現LSTM案例總結學習

- pytorch下的unsqueeze和squeeze的用法說明