讓立繪活起來 明日方舟終於實裝的Live2d技術究竟是什麼

Live2d,國內玩傢常將其稱為L2d,是一種現階段常見的繪圖渲染技術,在各種以2D立繪為主的遊戲以及虛擬主播行業中有著非常廣泛的運用。而在不久前《明日方舟》更新的2周年版本中,新的限定角色“濁心斯卡蒂”成為瞭遊戲中第二個,同時也是玩傢可控制的第一個擁有L2d立繪的角色。

(濁心斯卡蒂)

那麼為什麼《明日方舟》直到2周年才在角色身上實裝瞭L2d?這種我們習以為常的技術究竟是怎麼讓一張立繪“活”起來的?

聲明:本文僅作為L2d技術的簡單描述,如果想要深入瞭解可以前往Cybernoids官網,官網有提供完整的中文開發者指南

Live2d是由日本Cybernoids開發並發行的一種圖像處理技術,其特點在於能夠在不進行3D建模的前提下直接對已有的2D角色進行處理,從而使立繪根據開發者的需求進行活動。但是由於是在原本2D立繪的基礎上進行編輯改動,因此L2d無法做出太過復雜的動作,並且在一些動作上會存在一定的圖形拉伸變形。

不難看出,L2d技術本身是存在一定的缺陷的,但是這並沒有影響L2d技術的廣泛應用。這其中最大的優勢就是:與傳統的根據2D立繪進行建模再進行動作處理相比L2d的成本更低,而且能夠避免3D模型無法還原原本立繪效果的問題。

這兩點都很好理解,很多畫師本身的繪畫風格是相當不適合3D化的,強行3D化不僅會失去原本立繪的風格,更是會導致費大力氣做出來的3D模型和原立繪放在一起就充滿瞭廉價感。並且很多遊戲本身的呈現方式就不適合3D模型,比如你能夠想象一個全3D的《明日方舟》或者《公主連結》麼?

(就像這樣)

而L2d除瞭在保持原立繪觀感上具有優勢外,在成本上也存在一定的優勢。這一點看看現在大火的虛擬主播就能夠看出一二瞭。對比2D和3D的虛擬主播就很容易看出無論是表現力還是與觀眾互動的效果上3D模型+動作捕捉的組合都有著更好的效果,但是相比需要全套動作捕捉設備和高精度3D模型以及一臺實時進行渲染的3D直播方案相比,基於L2d技術的直播方案在成本和易用性上就要好上不少。以某虛擬主播企劃舉例,它就做到瞭將動作捕捉,L2d圖像處理以及直播這一系列的流程集成在瞭一臺iPhoneX中,無論是在便攜度還是在成本上L2d都要更勝一籌。

(全套的動作捕捉設備不僅成本高,還需要專業的場地和服裝)

在搞清楚為什麼L2d能夠普及之後,就讓我們來看看L2d究竟是怎麼實現讓立繪動起來這個過程的。

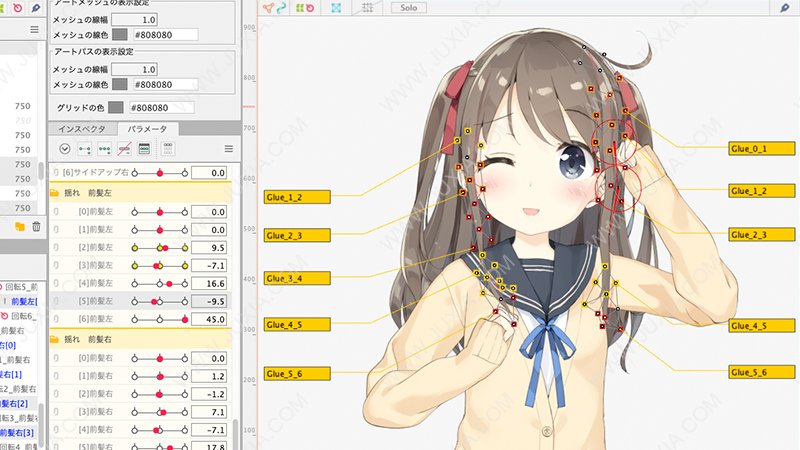

對L2d技術有一定瞭解的朋友對這張圖應該都不會陌生:

這是一張現有立繪的部位拆解圖,通過將原本立繪根據結構進行分解,填充的方式就能夠得到這樣的一張拆解圖,而這張拆解圖就是L2d技術的關鍵所在。

(原圖)

以高達等可動拼裝模型為例,想要讓模型的一個關節動起來就需要將這一個關節獨立出來並制作連結和傳動模塊。這張拆解圖就起到瞭同樣的作用,通過將原本立繪根據活動需求進行拆解的方式就能夠構成一個排佈著所有可移動部位的“板件”。

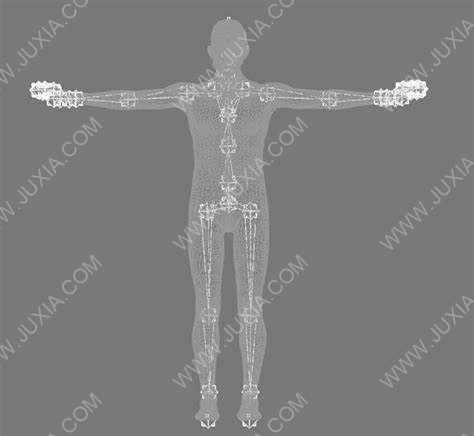

在完成瞭“板件”的制作之後接下來要做的就是拼裝和編輯動作瞭。在這一步用戶需要做的實際上和為3D模型綁定骨骼相當類似,因此在下文將把這一步驟稱為“綁骨”。

(3D模型綁定骨骼示意圖)

綁定骨骼最早是3D動畫及遊戲制作中的一個概念,大致可以理解為通過為已有的3D模型制作並綁定虛擬骨骼的方式使得模型能夠進行活動。在開發中建模師能夠通過調整骨骼的方式調整3D模型的動作。而在L2d中,能夠通過利用軟件中內置的多種“變形器”來實現對於軀幹,肢體,頭發,衣服等不同部位的不同變化。

而在完成的綁骨,將單個動作編輯好瞭之後就可以進行連續動作的制作瞭,L2d的軟件本身提供瞭時間軸編輯功能,使得用戶能夠在軟件內進行動作順序的編輯,並且進行導出,同時軟件也提供瞭與遊戲引擎的接口,使得遊戲開發者能夠直接將模型導入遊戲中。

看起來一切都非常美好。

但當你準備實際上手的時候,你就會發現這個看似簡單的流程其實處處都充斥著各種災難性的問題。

首先就是立繪拆分,在這一步中開發者就需要確定成品究竟需要作出什麼樣的動作,為瞭實現這些動作需要將哪些部位進行拆分,拆分又要拆分的多細致等等。並且由於這一步往往需要原畫師的配合還需要額外的溝通成本。如果恰巧原畫師抽不出空或者不願配合的話那恐怕就需要開發者自己動筆瞭。

那是不是在完成瞭拆分後就萬事大吉瞭?恰恰相反,編輯動作才是真正的噩夢。和3D角色的動作一樣,在L2d中想要讓角色做出動作和想要讓角色做出自然的動作是完全不同的兩個概念,前者隻需要簡單的拖動調整就能夠實現,代價就是搞出來的往往會是一堆動作詭異的奇行種;而後者雖然能夠使得動作細致,但就需要開發者對每個關鍵幀(動作中的關鍵節點)進行細致的微調。不過好在現在有瞭能夠應用於L2d上的動作捕捉技術,能夠很大程度的解決這一步的工作量。

那麼現在,放在我們面前的是歷盡千辛萬苦終於完成的L2d人物,我們隻剩下瞭把做好的人物倒進遊戲中這一步瞭,是不是可以松口氣瞭呢?也不是。在網上簡單搜索就不難看到在導入這一步中有著茫茫多的開發者遇到瞭各種各樣奇奇怪怪的問題,無論是部件丟失,圖層錯誤還是骨骼丟失都是再常見不過的事情瞭。這也導致很多開發者幹脆就是用L2d做好角色動作之後直接導出成視頻或者GIF圖的形式再放進遊戲中——雖然這樣子互動性會差一些,但至少沒bug啊。

(Cybernoids自己就提供瞭相關功能)

說瞭這麼多,讓我們回到一開始的問題:為什麼《明日方舟》直到2周年才實裝瞭第一個擁有動態立繪的角色?工期,質量都是原因。濁心斯卡蒂的精二立繪有著相當復雜的元素,想要把這些元素全部進行動態化光最初的拆分就需要和原畫師進行大量的磨合交流,動作的制作更是復雜,想要實現遊戲中的效果並不是什麼易事。

因此,對於《明日方舟》來說現階段這種為限定角色制作動態立繪是一種較為折中且比較合適的方法,至少在我看來如果後續其他角色的動態立繪能夠保持濁心斯卡蒂精二立繪質量的話,現在的更新策略是完全可以接受的。

最後說明一下,雖然本文一直以《明日方舟》中濁心斯卡蒂的動態效果是以L2d制作為前提進行分析,但是在鷹角沒有明確表示的情況下這一點依舊不能完全確定,也存在是使用Spine等軟件進行制作的可能,不過即便如此本文中的大部分關於《明日方舟》的內容也基本成立,再不濟也能夠當做L2d的簡單制作科普來看不是麼?

(用Spine的可能也不是沒有)

本文系作者投稿,不代表聚俠網觀點

推薦閱讀:

- Python matplotlib的spines模塊實例詳解

- 深入理解Java設計模式之簡單工廠模式

- IntelliJ IDEA自定義代碼提示模板Live Templates的圖文教程

- Java中常用的設計模式之裝飾器模式詳解

- java中Lamda表達式講解