python實現Scrapy爬取網易新聞

1. 新建項目

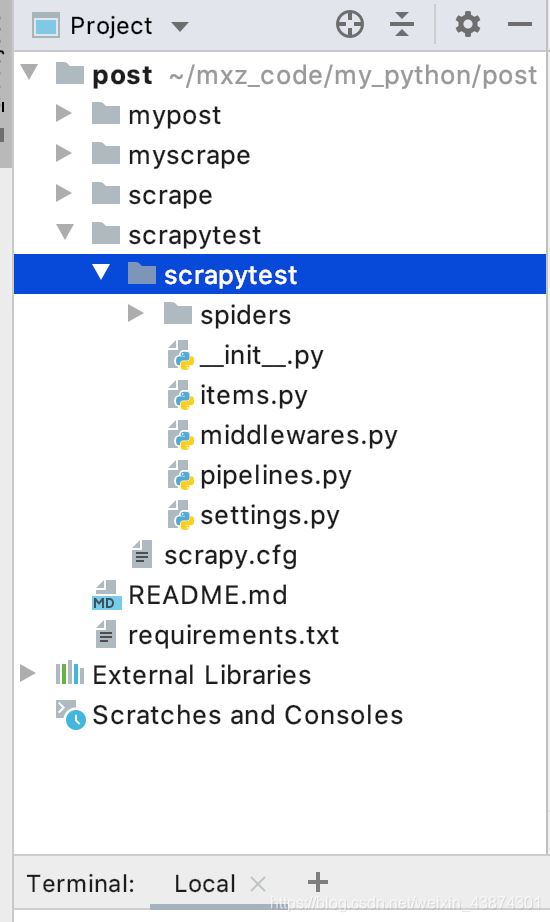

在命令行窗口下輸入scrapy startproject scrapytest, 如下

然後就自動創建瞭相應的文件,如下

2. 修改itmes.py文件

打開scrapy框架自動創建的items.py文件,如下

# Define here the models for your scraped items # # See documentation in: # https://docs.scrapy.org/en/latest/topics/items.html import scrapy class ScrapytestItem(scrapy.Item): # define the fields for your item here like: # name = scrapy.Field() pass

編寫裡面的代碼,確定我要獲取的信息,比如新聞標題,url,時間,來源,來源的url,新聞的內容等

class ScrapytestItem(scrapy.Item): # define the fields for your item here like: # name = scrapy.Field() title = scrapy.Field() timestamp = scrapy.Field() category = scrapy.Field() content = scrapy.Field() url = scrapy.Field() pass

3. 定義spider,創建一個爬蟲模板

3.1 創建crawl爬蟲模板

在命令行窗口下面 創建一個crawl爬蟲模板(註意在文件的根目錄下面,指令檢查別輸入錯誤,-t 表示使用後面的crawl模板),會在spider文件夾生成一個news163.py文件

scrapy genspider -t crawl codingce news.163.com

然後看一下這個‘crawl’模板和一般的模板有什麼區別,多瞭鏈接提取器還有一些爬蟲規則,這樣就有利於我們做一些深度信息的爬取

import scrapy

from scrapy.linkextractors import LinkExtractor

from scrapy.spiders import CrawlSpider, Rule

class CodingceSpider(CrawlSpider):

name = 'codingce'

allowed_domains = ['163.com']

start_urls = ['http://news.163.com/']

rules = (

Rule(LinkExtractor(allow=r'Items/'), callback='parse_item', follow=True),

)

def parse_item(self, response):

item = {}

#item['domain_id'] = response.xpath('//input[@id="sid"]/@value').get()

#item['name'] = response.xpath('//div[@id="name"]').get()

#item['description'] = response.xpath('//div[@id="description"]').get()

return item

3.2 補充知識:selectors選擇器

支持xpath和css,xpath語法如下

/html/head/title /html/head/title/text() //td (深度提取的話就是兩個/) //div[@class=‘mine']

3.3. 分析網頁內容

在谷歌chrome瀏覽器下,打在網頁新聞的網站,選擇查看源代碼,確認我們可以獲取到itmes.py文件的內容(其實那裡面的要獲取的就是查看瞭網頁源代碼之後確定可以獲取的)

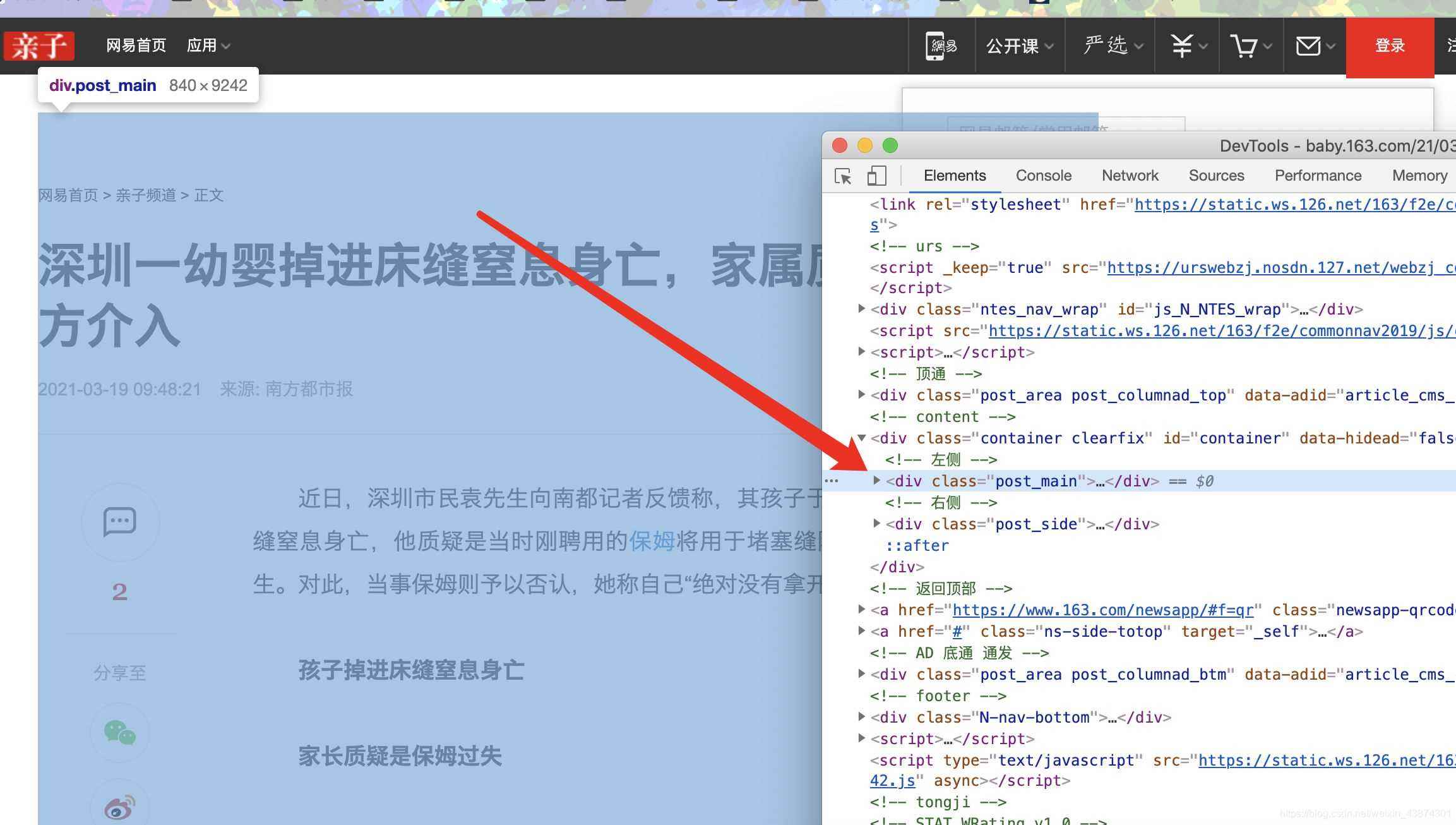

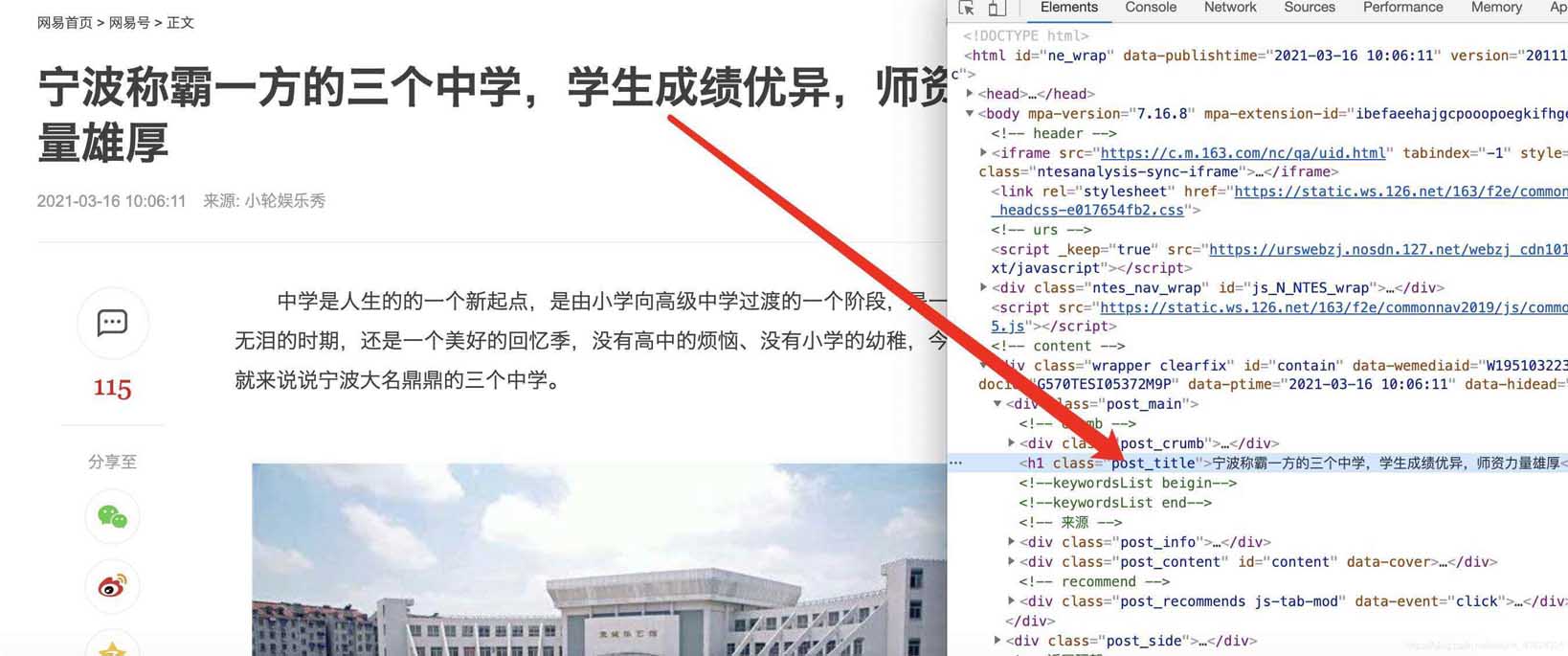

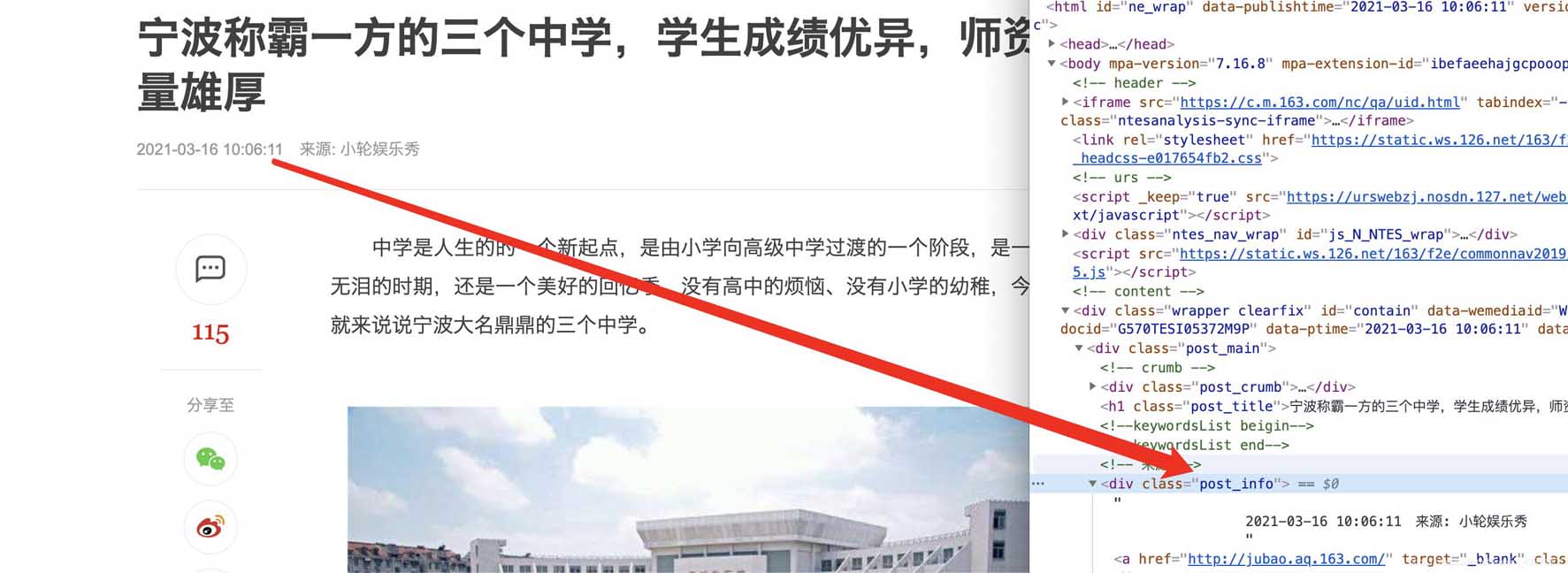

確認標題、時間、url、來源url和內容可以通過檢查和標簽對應上,比如正文部分

主體

標題

時間

分類

4. 修改spider下創建的爬蟲文件

4.1 導入包

打開創建的爬蟲模板,進行代碼的編寫,除瞭導入系統自動創建的三個庫,我們還需要導入news.items(這裡就涉及到瞭包的概念瞭,最開始說的–init–.py文件存在說明這個文件夾就是一個包可以直接導入,不需要安裝)

註意:使用的類ExampleSpider一定要繼承自CrawlSpider,因為最開始我們創建的就是一個‘crawl'的爬蟲模板,對應上

import scrapy

from scrapy.linkextractors import LinkExtractor

from scrapy.spiders import CrawlSpider, Rule

from scrapytest.items import ScrapytestItem

class CodingceSpider(CrawlSpider):

name = 'codingce'

allowed_domains = ['163.com']

start_urls = ['http://news.163.com/']

rules = (

Rule(LinkExtractor(allow=r'.*\.163\.com/\d{2}/\d{4}/\d{2}/.*\.html'), callback='parse', follow=True),

)

def parse(self, response):

item = {}

content = '<br>'.join(response.css('.post_content p::text').getall())

if len(content) < 100:

return

return item

Rule(LinkExtractor(allow=r’..163.com/\d{2}/\d{4}/\d{2}/..html’), callback=‘parse’, follow=True), 其中第一個allow裡面是書寫正則表達式的(也是我們核心要輸入的內容),第二個是回調函數,第三個表示是否允許深入

最終代碼

from datetime import datetime

import re

import scrapy

from scrapy.linkextractors import LinkExtractor

from scrapy.spiders import CrawlSpider, Rule

from scrapytest.items import ScrapytestItem

class CodingceSpider(CrawlSpider):

name = 'codingce'

allowed_domains = ['163.com']

start_urls = ['http://news.163.com/']

rules = (

Rule(LinkExtractor(allow=r'.*\.163\.com/\d{2}/\d{4}/\d{2}/.*\.html'), callback='parse', follow=True),

)

def parse(self, response):

item = {}

content = '<br>'.join(response.css('.post_content p::text').getall())

if len(content) < 100:

return

title = response.css('h1::text').get()

category = response.css('.post_crumb a::text').getall()[-1]

print(category, "=======category")

time_text = response.css('.post_info::text').get()

timestamp_text = re.search(r'\d{4}-\d{2}-\d{2} \d{2}:\d{2}:\d{2}', time_text).group()

timestamp = datetime.fromisoformat(timestamp_text)

print(title, "=========title")

print(content, "===============content")

print(timestamp, "==============timestamp")

print(response.url)

return item

到此這篇關於python實現Scrapy爬取網易新聞的文章就介紹到這瞭,更多相關python Scrapy爬取網易新聞內容請搜索WalkonNet以前的文章或繼續瀏覽下面的相關文章希望大傢以後多多支持WalkonNet!

推薦閱讀:

- python Scrapy框架原理解析

- Python爬蟲教程使用Scrapy框架爬取小說代碼示例

- 使用scrapy實現增量式爬取方式

- Django結合使用Scrapy爬取數據入庫的方法示例

- Python scrapy爬取起點中文網小說榜單